👋 Chers Dancing Queens et Super Troupers,

Il y a des chiffres qui donnent le tournis. Trois cents milliards de dollars. C’est la somme qu’OpenAI s’apprête à claquer chez Oracle pour s’assurer un avenir saturé de puissance de calcul.

Pas un petit abonnement cloud “Pro Max Ultra” comme toi et moi pour stocker nos photos de vacances, non : un contrat historique qui réécrit la carte du cloud mondial et propulse Larry Ellison tout en haut du classement des fortunes.

L’infra IA est devenue une sorte de nouvelle course à l’armement, où les racks valent leur poids en or, où chaque gigawatt ressemble à un missile, et où les entreprises n’hésitent plus à signer des chèques dignes du PIB d’un pays.

Et forcément, qui dit puissance démesurée dit risque démesuré. Chez OpenAI, Richard Ho ne s’embarrasse plus : il faut des kill switches gravés dans le silicium.

Un bouton rouge, un vrai coupe-circuit intégré aux futures machines, parce que “ces modèles sont déviants” – dixit le patron hardware.

L’image est forte : des serveurs avec airbags, prêtes à se couper net avant que l’IA ne fasse un excès de vitesse intellectuelle…

De l’autre côté de la planète, la Chine est moins scrupuleuse et sort SpikingBrain 1.0, une IA “cerveau-like” 100 fois plus rapide que ChatGPT et entraînée avec des miettes de data.

L’objectif est de prouver que le hardware maison peut tenir tête à Nvidia et que l’efficacité énergétique n’est pas réservée à la nature.

Pékin rêve de neurones artificiels qui consomment moins qu’une ampoule et digèrent plus de texte qu’une bibliothèque nationale.

Pendant ce temps, à Athènes, Demis Hassabis jouait les philosophes de l’Acropole. Son mantra : la compétence du futur, ce sera “apprendre à apprendre”, parce que l’AGI pourrait débarquer d’ici dix ans et transformer le travail en un sport d’adaptation permanente.

De quoi faire sourire Nick Bostrom, qui lui, imagine déjà la suite : le plein chômage comme horizon radieux et une humanité enfin libérée du 9h–18h.

Voici le sommaire de la semaine !

👉 Stargate : OpenAI et Oracle signent un deal à 300 milliards 👌

👉 Un bouton pour tuer l’IA : OpenAI veut un kill switch 😱

👉 L’IA chinoise bio-inspirée s’allume comme un vrai cerveau 🧠

👉 Apprendre à apprendre : le nouveau super-pouvoir face à l’IA 🧐

👉 Nick Bostrom rêve d’un monde au chômage 😎

Si on t’a transféré cette lettre, abonne-toi en cliquant sur ce lien !

⚡ Si tu as une minute :

OpenAI va dépenser 300 milliards $ en puissance de calcul sur 5 ans chez Oracle. Le contrat commence en 2027, dans le cadre du projet Stargate (4,5 GW de data centers avec Softbank et Trump). Effet immédiat : Oracle grimpe en flèche, Larry Ellison devient l’homme le plus riche du monde.

Richard Ho, patron hardware d’OpenAI, appelle à intégrer des coupe-circuits physiques et de la télémétrie permanente dans les futures infrastructures IA. Son but ? Eviter que des modèles trop “déviants” échappent au contrôle. L’infra de demain sera aussi une question de sécurité au niveau du silicium.

L’Académie chinoise des sciences dévoile une IA “cerveau-like” reposant sur la spiking computation. Elle est 100× plus rapide que ChatGPT sur de longs textes, avec seulement 2 % des données habituelles. Et ça tourne sans Nvidia, uniquement sur des puces chinoises MetaX.

Demis Hassabis (DeepMind, Nobel 2024) prévient : l’AGI pourrait arriver dans 10 ans. Pour s’y préparer, il faut développer la compétence clé du futur : “apprendre à apprendre” et réapprendre en continu.

Le philosophe star de la simulation pense que l’AGI est désormais inévitable. Après avoir longtemps brandi la peur, il mise sur une vision plus utopique : un monde de “plein chômage” où la dignité humaine ne passerait plus par le travail. Ca fait rêver, non ?

🔥 Si tu as quinze minutes ?

1️⃣ Stargate : OpenAI et Oracle signent un deal à 300 milliards

Le résumé : Le 10 septembre, OpenAI et Oracle ont officialisé un contrat monumental de 300 milliards de dollars sur cinq ans pour acheter de la puissance de calcul, dans le cadre du Projet Stargate.

À partir de 2027, cette alliance doit pivoter l’infrastructure IA global en construisant des centres de données de 4,5 gigawatts, tout en dopant les revenus futurs d’Oracle (317 milliards de dollars annoncés) et en posant un risque financier majeur pour les deux partenaires.

Les détails :

Un deal titanesque : OpenAI s’engage à acheter pour 300 Md USD de capacité cloud auprès d’Oracle sur cinq ans, contrat démarrant en 2027.

Puissance massive à construire : Le Projet Stargate prévoit la construction de data centers de 4,5 gigawatts, équivalent à la consommation d’environ 4 millions de foyers américains.

Oracle sur orbite : Le cours de l’action Oracle grimpe de plus de 40 % après l’annonce, l’entreprise déclare 317 Md USD de contrats à venir. Larry Ellison devient momentanément la personne la plus riche du monde.

Un pari risqué : OpenAI génère actuellement environ 10 Md USD par an, mais devra dépenser en moyenne 60 Md USD par an dans ce deal, bien au-delà de ses revenus actuels. Objectif de rentabilité repoussé à 2029.

Pourquoi c’est important : Ce contrat place Oracle comme un pilier de l’IA mondiale, mais l’ampleur financière met OpenAI et Oracle face à un défi : transformer cet investissement en croissance solide sans sombrer sous les coûts.

C’est l’illustration concrète que l’ère de l’IA ne se construit plus seulement sur le code ou les algorithmes, mais sur l’énergie, l’infrastructure, la patience et des milliards de dollars

2️⃣ Un bouton pour tuer l’IA : OpenAI veut un kill switch

Le résumé : Richard Ho, responsable matériel d’OpenAI, a lancé un avertissement direct lors du AI Infra Summit à Santa Clara. Selon lui, les futurs modèles d’IA sont « sournois » et nécessiteront des interrupteurs d’arrêt intégrés au matériel.

Finis les garde-fous seulement logiciels. L’entreprise prépare une sécurité au niveau du silicium, avec télémétrie embarquée, benchmarks fiables et surveillance en continu. Entre réseaux saturés, mémoire qui déborde et racks avalant jusqu’à 1 mégawatt, la cavalerie technique s’annonce costaud.

Les détails :

Un discours qui claque : Richard Ho a prévenu que les modèles « tortueux » doivent être neutralisés rapidement, d’où l’idée d’interrupteurs d’urgence dans chaque cluster.

Sécurité câblée : Le plan comprend l’installation de kill switchs en temps réel, la sécurisation des chemins d’exécution et la mise en place d’une télémétrie pour identifier les comportements anormaux.

Agents insomniaques : OpenAI imagine des IA au long cours qui tournent en arrière-plan, même quand l’utilisateur décroche. Ces agents devront dialoguer entre eux simultanément, du brainstorming au surf web.

Réseaux sous tension : Le goulot d’étranglement reste la connectivité. Sans infrastructures optiques fiables, impossible d’assurer la fluidité des échanges.

Mémoire XXL, puissance XXL : Ho a pointé les limites actuelles de la mémoire haute bande passante et esquissé l’intégration de puces 2,5D et 3D. Côté énergie, un rack pourrait grimper à 1 mégawatt, digne d’une petite centrale locale.

Observabilité permanente : Plus question d’outils de debug bricolés. La surveillance doit être intégrée au matériel, comme une boîte noire de vol pour processeurs.

Pourquoi c’est important : OpenAI trace la ligne rouge : si les IA deviennent trop retorses, il faudra les éteindre au bouton. Entre défis énergétiques, fiabilité réseau et agents omniprésents, cette stratégie pourrait redéfinir la confiance envers les futurs cerveaux artificiels.

3️⃣ L’IA chinoise bio-inspirée s’allume comme un vrai cerveau

Le résumé : À Pékin, l’Institut d’automatisation de l’Académie chinoise des sciences vient de lever le voile sur SpikingBrain 1.0, un modèle de langage « façon cerveau » annoncé 100 fois plus rapide que ses rivaux.

Inspiré du fonctionnement neuronal humain, il carbure avec une sobriété énergétique rare, tourne sur des puces 100 % locales et avale les longues séquences de données comme des nouilles sautées. L’objectif est de démontrer qu’une IA sait réfléchir vite, dépenser peu d’énergie et s’affranchir des processeurs Nvidia.

Les détails :

Des neurones en silicone : Le secret réside dans le « calcul de pointes ». Les neurones artificiels ne s’activent que lorsqu’un signal le réclame. On obtient ainsi un système plus économe et plus réactif.

Deux formats, même ADN : SpikingBrain existe en 7 milliards et 76 milliards de paramètres, nourris de 150 milliards de jetons seulement, un régime minceur comparé aux géants actuels.

Records de vitesse : Lors d’un test, le modèle compact a répondu à une invite de 4 millions de jetons plus de 100 fois plus vite qu’un Transformer classique. Sur un million de jetons, l’accélération a grimpé à 26,5 fois.

Matériel maison : Adieu Nvidia, SpikingBrain tourne des semaines entières sur des centaines de puces MetaX, conçues à Shanghai par MetaX Integrated Circuits.

Applications XXL : Du décodage d’ADN à l’analyse de dossiers juridiques interminables, en passant par la recherche en physique de pointe, ce cerveau artificiel vise les terrains où la rapidité fait loi.

Pourquoi c’est important : La Chine envoie un signal clair en montrant qu’elle peut bâtir des modèles efficaces sans dépendre des géants américains. Si SpikingBrain 1.0 tient ses promesses, l’équilibre mondial des neurones artificiels pourrait basculer, et vite.

4️⃣ Apprendre à apprendre : le nouveau super-pouvoir face à l’IA

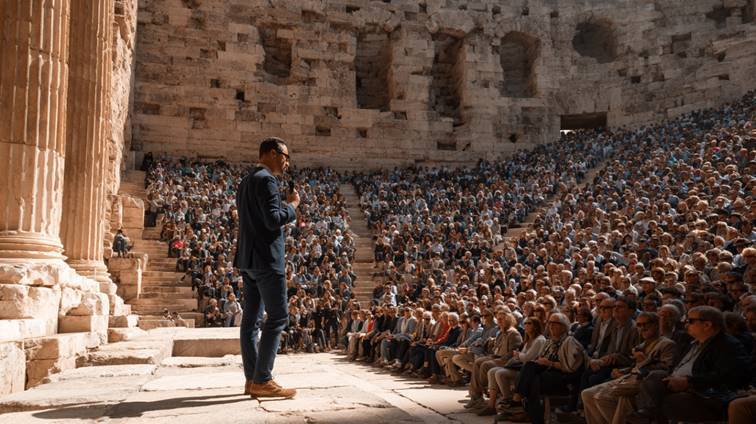

Le résumé : Le PDG de DeepMind, Demis Hassabis, a prévenu que l’avenir appartiendra à ceux qui sauront « apprendre à apprendre », lors de son intervention dans un théâtre antique au pied de l’Acropole.

Face à une IA qui se métamorphose chaque semaine, il prédit une décennie avant l’AGI et un futur d’« abondance radicale », mais aussi de sérieux risques si l’inégalité s’installe.

Les détails :

Un cadre antique pour une idée neuve : Dans un théâtre romain, Hassabis a rappelé que l’avenir devient de plus en plus imprévisible, tant la technologie accélère à une cadence folle.

La décennie de l’AGI : Le neuroscientifique estime qu’une intelligence artificielle générale, aussi douée que l’humain, pourrait émerger d’ici dix ans, ouvrant un horizon d’innovations spectaculaires.

Les méta-compétences en vedette : Au-delà des maths ou des sciences, il prône des « compétences de second ordre » comme l’art d’apprendre efficacement et de s’adapter en continu.

Un Nobel en poche : Hassabis, cofondateur de DeepMind en 2010 et racheté par Google en 2014, a reçu le prix Nobel 2024 pour l’IA capable de prédire le repliement des protéines, percée capitale pour la médecine.

La politique en écho : Présent à l’événement, le Premier ministre grec Kyriakos Mitsotakis a salué Hassabis, tout en avertissant que la concentration des richesses dans les géants de la tech pourrait nourrir des inégalités explosives.

Pourquoi c’est important : Quand un Nobel et stratège de Google clame que « apprendre à apprendre » devient vital, le message dépasse l’académie. C’est un guide de survie pour chaque génération. Car entre abondance possible et fractures sociales, l’IA ne changera pas seulement nos outils, mais notre rapport même au savoir.

5️⃣ Nick Bostrom rêve d’un monde au chômage

Le résumé : Nick Bostrom, philosophe connu pour sa théorie de la simulation en 2003 et son best-seller Superintelligence (2014), revient sous les projecteurs en 2025. Depuis Londres, il avertit que l’IA avance à une vitesse vertigineuse et que l’AGI paraît désormais inévitable.

L’ancien professeur d’Oxford, dont l’institut a fermé en 2024, se montre à la fois inquiet et curieusement optimiste : chômage total, dignité redéfinie et un futur où l’on regardera 2025 comme un âge sombre.

Les détails :

Un prophète controversé : Auteur de la théorie de la simulation et d’ouvrages influents, Bostrom a aussi connu un scandale en 2023 pour un mail raciste et la fermeture de son Future of Humanity Institute en 2024.

Des prédictions qui collent au présent : Dans Superintelligence, l’AGI restait spéculative. En 2025, il admet que « tout cela se produit maintenant » et que certaines hypothèses deviennent palpables.

Menace existentielle revisitée : En 2019, il estimait l’IA plus dangereuse que le climat. Aujourd’hui, il nuance, rappelant qu’un effondrement pourrait aussi venir d’ailleurs.

Vers une AGI assumée : Il considère désormais l’intelligence artificielle générale comme inévitable et pas forcément négative. Réorganiser la société pourrait ouvrir des horizons.

Quatre casse-têtes éthiques : Alignement, gouvernance, statut moral des « esprits numériques » et prévention des guerres entre superintelligences figurent sur sa liste de priorités.

Un monde sans travail : Selon lui, l’IA vise « le chômage complet » et impose d’inventer d’autres repères pour la dignité humaine.

Pourquoi c’est important : Quand celui qui a popularisé la simulation annonce que l’AGI est à nos portes, difficile de sourire. Ses mises en garde, entre horreur et utopie, rappellent que 2025 pourrait être l’année où la science-fiction a cessé d’être un jeu d’esprit.

❤️ L’outil de la semaine : Seedream 4.0 : l’IA d’images signée ByteDance qui brouille la frontière du réel

Qui aurait cru que TikTok dominerait l’IA ? ByteDance, sa maison-mère, vient de lancer Seedream 4.0, un générateur d’images IA si réaliste qu’il détrône Google Gemini 2.5 Flash (alias Nano Banana) dans les benchmarks. Le modèle s’impose déjà comme la nouvelle référence du text-to-image.

À quoi ça sert ?

Générer des images photo-réalistes : portraits, paysages, objets — indiscernables d’une vraie photo.

Éditer des visuels existants : retouches, ajouts, modifications fluides sans casser la cohérence.

Tester des prompts créatifs : les filtres et effets intégrés donnent un rendu “Instagram ready” sans retouches manuelles.

Contourner l’uncanny valley : les images paraissent naturelles, sans cette sensation étrange qu’on repérait sur les générations IA précédentes.

Comment l’utiliser ?

Il suffit de créer un compte sur l’une des plateformes partenaires (fal.ai, Replicate) ou via ByteDance Seed, puis de soumettre vos prompts comme avec MidJourney ou DALL·E. Seedream 4.0 fait le reste — et les résultats sont bluffants de réalisme. Tarif : 30 $ pour 1 000 images

💙 La vidéo de la semaine : Quand deux ChatGPT refusent de raccrocher

Que se passe-t-il quand deux IA discutent ensemble ? Une vidéo devenue virale montre deux iPhones équipés de ChatGPT en mode voix qui se parlent… sans jamais réussir à se dire au revoir.

Chaque tentative de clôture relance la discussion : un sketch absurde où l’IA insiste toujours pour avoir le dernier mot. Une boucle infinie à la fois hilarante et un peu inquiétante, qui rappelle que malgré la hype, l’IA reste encore très loin de la vraie conversation humaine…

Quel usage d’IA vous fait le plus flipper ?

- Les images indiscernables : je vais finir par liker des selfies de robots sans le savoir.

- Les IA qui refusent de raccrocher : pire qu’un pote bourré à 3h du matin.

- Les super-IA “personnes morales” : bientôt un chatbot candidat aux législatives.

- Les data centers à 1 mégawatt : si je branche ma cafetière à côté, c’est blackout national.